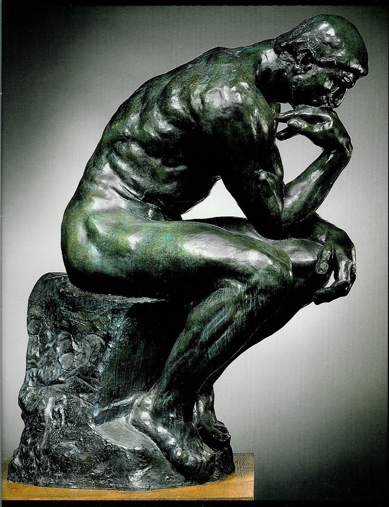

Tenkning, intelligens, bevissthet

Hva tenker du på akkurat nå?

Kanskje du lurer på hva dette kapittelet vil handle om. Kanskje du allerede har begynt å lete etter sammenhenger mellom det du leser, og det du vet fra før. Eller kanskje du, mens du leser disse ordene, blir distrahert av en annen tanke – et minne, hva du skal spise til middag, en oppgave du må huske, eller noe helt annet.

Tenkning kan defineres som prosessen der vi tar inn informasjon, bearbeider den, og bruker den til å trekke konklusjoner eller ta beslutninger, men hva betyr det egentlig å tenke?

Er tenkning en fysisk prosess, der elektriske og kjemiske signaler farer mellom de 80 milliardene av nevroner i hjernen? Er det en biologisk form for informasjonsbehandling? Eller er det noe langt mer mystisk – en form for bevissthet eller sjel som ikke kan reduseres til ren fysikk?

Dette spørsmålet har fascinert filosofer, forskere og ingeniører i årtusener. Og i vår tid, der vi utvikler stadig mer avanserte maskiner, stilles spørsmålet med ny tyngde: Kan en maskin tenke? Dette ene spørsmålet fører til en lang rekke andre som disse:

Hva betyr det egentlig å tenke? Kan en maskin noensinne tenke på samme måte som et menneske, eller handler kunstig intelligens utelukkende om avansert statistikk, sannsynlighetsregning og mønstergjenkjenning?

Kan en maskin bli bevisst? Mange hevder at bevissthet krever en biologisk hjerne, mens andre mener at bevissthet kan oppstå gjennom kompleks informasjonshåndtering.

Selvbevissthet – en illusjon eller en nødvendighet? Å forstå seg selv i en kontekst, å reflektere over egen eksistens – er dette noe en maskin noensinne kan oppnå?

Er kunstig intelligens en naturlig del av vår egen evolusjon? Noen hevder at KI bare er neste steg i menneskets utvikling – en utvidelse av våre kognitive evner, på samme måte som verktøy og maskiner tidligere har forsterket våre fysiske evner.

Setter vi nå evolusjonen «på speed»? Teknologiutviklingen skjer eksponentielt – vi former KI, men samtidig begynner KI å forme oss. Hva betyr dette for menneskets rolle i fremtiden?

Blir vi nå arkitektene av vår egen evolusjon? For første gang kan vi ikke bare tilpasse oss naturen, men aktivt designe systemer som kan endre hvordan vi lever, tenker og samhandler. Hvor går grensen mellom teknologi som hjelper oss – og teknologi som endrer oss?

Filosofen René Descartes[1] (1596–1650) stilte på 1600-tallet det berømte spørsmålet: Hva kan jeg vite med absolutt sikkerhet? Svaret hans var enkelt, men dypt: Cogito, ergo sum, eller på norsk: Jeg tenker, altså er jeg. For Descartes var tenkning ikke bare en prosess, men selve beviset på eksistens. Dette verdensbildet var en del av dualismen, en filosofisk retning som skiller skarpt mellom den fysiske verden og den mentale eller spirituelle verden. Ifølge dette synet er mennesker unike fordi vi har en bevissthet, mens dyr og maskiner bare er komplekse automater – de kan bevege seg, reagere på stimuli, men de kan ikke tenke i egentlig forstand.

Denne dualistiske tankegangen har preget vestlig filosofi og vitenskap i århundrer og påvirker fortsatt vår forståelse av bevissthet, tenkning og intelligens i dag. Men i det 20. århundret utfordret Norbert Wiener[2] (1894–1964), grunnleggeren av kybernetikken, dette synet. I sin banebrytende bok Cybernetics: Control and Communication in the Animal and the Machine (1948) viste han hvordan både levende vesener og avanserte maskiner bruker tilbakekoblingsmekanismer for å regulere atferd. Wiener argumenterte for at det ikke nødvendigvis er en skarp grense mellom bevisst tenkning og mekanisk informasjonsbehandling – forskjellen kan være gradvis.

Mens Descartes’ rasjonalisme var med på å revolusjonere den vitenskapelige tenkemåten ved å legge vekt på logikk, analyse og matematiske modeller, så han tenkning som en unik egenskap knyttet til sjelen – en skarp dualisme mellom det mentale og det fysiske.

Wiener, derimot, fokuserte på hvordan systemer, enten de er biologiske eller maskinelle, kan ta beslutninger gjennom kontinuerlig tilbakemelding fra omgivelsene. Mens Descartes la grunnlaget for den moderne vitenskapelig metode, la Wieners kybernetikk grunnlaget for vår forståelse av intelligens som en prosess basert på dynamiske feedbacksløyfer. Begge perspektivene har vært avgjørende for utviklingen av både vitenskap og teknologi, og sammen har de formet vår forståelse av beslutningstaking – både hos mennesker og maskiner.

Er tenkning det samme som intelligens?

Vi tenker noen ganger på at høy intelligens og avansert tenkning som noe av det samme, men stemmer det? En, av flere mulig definisjon av intelligens er evnen til å løse komplekse problemer. Men forutsetter dette evnen til avansert tenkning?

Tenk på en papegøye som kan etterligne menneskelig tale. Den kan si setninger, men forstår den hva den sier? Eller tenk på en avansert Kunstig Intelligens (KI), som kan analysere tusenvis av medisinske bilder og stille diagnoser like presist som en lege. Betyr det at KI-en tenker?

Alan Turing[3] (1912–1954) mente at spørsmålet om en maskin tenker egentlig er irrelevant. Det som betyr noe, sa han, er hva maskinen kan gjøre. Han foreslo Turing-testen som en måte å måle kunstig intelligens på: Hvis en maskin kan føre en samtale på en måte som er umulig å skille fra et menneske, må vi da ikke konkludere med at den tenker?

Men er tenkning bare atferd?

Den amerikanske filosofen John Searle[4] (f. 1932) var uenig i dette. Han mente at en maskin kan simulere forståelse uten faktisk å forstå noe som helst. For å forklare dette introduserte han et berømt tankeeksperiment kalt det kinesiske rommet:

Tenk deg at du sitter inne i et rom med en bok som inneholder detaljerte regler for hvordan du skal svare på lapper med kinesiske tegn som blir sendt inn gjennom en luke. Selv om du ikke forstår kinesisk, kan du ved hjelp av boken finne de riktige svarene og sende en ny lapp tilbake. For personen utenfor rommet ser det ut som om du har en samtale på kinesisk, men i virkeligheten forstår du ikke språket – du følger bare regler.

Searles hovedpoeng er at syntaks (regler for hvordan noe skrives korrekt) alene ikke er nok til å skape semantikk (regler for hvorfor noe gir mening). Selv om en datamaskin kan manipulere symboler på en måte som simulerer forståelse betyr det ikke at systemet har virkelig forståelse eller bevissthet.

Dette tankeeksperimentet understreker en grunnleggende utfordring i arbeidet med kunstig intelligens: Kan maskiner noensinne gå utover å simulere intelligens til faktisk å forstå verden?

En mulig tilnærming til et svar på dette spørsmålet ligger i hvordan vi representerer verden inni oss. Når vi mennesker tenker, erfarer og lærer, bygger vi mentale modeller. Vi skaper en indre forståelse av hvordan verden fungerer, og vi bruker disse modellene til å forstå den aktuelle situasjonen vi befinner oss i, til å forutsi hva som vil skje og til å ta beslutninger basert på dette.

Når du for eksempel kjører i bilen din langs en gate og du ser en ball rulle ut i veien, tenker du ikke bare: «Dette er en ball.» Du vet at baller ofte leker barn med, og at et barn kan følge etter. Du forstår situasjonen i en større sammenheng og handler deretter. En liten unge som slipper legoklossen, forstår intuitivt at den vil falle i gulvet og tenker ikke «Newton rett også denne gangen. Hans 2.lov stemmer på en prikk. Hver gang».

Datamaskiner fungerer på en annen måte. De bygger ikke mentale modeller, men matematiske modeller basert på statistikk eller lærende algoritmer. En selvkjørende bil kan trenes på millioner av bilder og lære at en ball i veibanen ofte betyr at det kommer et barn – men den forstår ikke denne sammenhengen slik vi gjør.

Læring kan defineres som evnen til å bygge opp indre modeller av verden gjennom interaksjon med omgivelsene. Vi lærer ikke bare ved å motta informasjon, men ved å teste ut hypoteser, prøve og feile, og gradvis forbedre vår forståelse. Jeff Hawkins[5] (f. 1957), kjent for sin teori om intelligens og forfatter av A Thousand Brains: A New Theory of Intelligence, beskriver dette treffende:

«Intelligence is the ability to learn a model of the world. With few exceptions, learning new ideas and skills requires physically interacting with the world.»

Hawkins’ arbeid understreker hvordan læring skjer gjennom kontinuerlig interaksjon med omgivelsene, og hvordan vi lager modeller for å forstå og forutsi verden rundt oss. Bevisstheten vår kan i denne sammenhengen oppfattes som en avansert prediksjonsmaskin, som kontinuerlig forsøker å forutsi fremtiden basert på tidligere erfaringer og justere våre indre modeller når avvik oppstår.

Er maskiner i stand til å lære? Kan en maskin uten en fysisk kropp – altså uten evnen til å lære ved interaksjon med omgivelsene – etablere egne modeller av verden?

I dag utvikles maskiner med stadig mer avansert maskinlæring, men dette er fortsatt basert på statistisk mønstergjenkjenning, ikke på aktiv utforsking av verden slik vi mennesker gjør. Her kommer også forskjellen mellom automatisering og autonomi inn. Enkle maskiner er regelstyrte – de følger forhåndsdefinerte instruksjoner. Et autonomt system derimot, må kunne tilpasse seg, lære av erfaring og ta beslutninger i nye situasjoner.

Er tenkning avhengig av bevissthet?

Bevissthet bringer oss til et enda dypere spørsmål: Er tenkning mulig uten bevissthet? Bevissthet innebærer ikke bare evnen til å oppfatte verden, men å være klar over seg selv som en del av den. Filosofen Thomas Nagel[6] spør i sitt essay What Is It Like to Be a Bat? hvordan subjektiv opplevelse og selvbevissthet kan forstås. Kan maskiner noen gang oppnå denne typen subjektivitet, eller er bevissthet et fenomen som kun kan oppstå i biologiske systemer?

Må en tenkende enhet være bevisst?

Noen vil hevde at tenkning er en prosess – en måte å behandle informasjon på – og at bevissthet ikke er en nødvendig del av denne prosessen. En kalkulator kan løse komplekse ligninger, men ingen ville påstå at den er bevisst. En avansert KI kan analysere enorme mengder data og ta sofistikerte beslutninger, men er den mer enn bare en maskin som simulerer intelligens?

Bevissthet kan forstås som en emergent egenskap som oppstår når et tilstrekkelig antall nevroner samhandler gjennom komplekse tilbakekoblingsmekanismer. Når informasjonsflyt og koblinger i hjernen når en viss terskel, kan selvorganisering gi opphav til høyere ordens fenomen som selvbevissthet og introspeksjon. Emergens kan forklare hvordan komplekse systemer organiserer seg, men forklarer ikke nødvendigvis hvorfor bevissthet oppstår eller hva det fundamentalt er.

Filosofen David Chalmers[7] (f. 1966) har kalt dette The Hard Problem of Consciousness[8]: Hvorfor føles det som noe å være oss? Hvorfor er ikke hjernen bare en avansert datamaskin som behandler informasjon uten noen subjektiv opplevelse?

Kan en maskin noen gang bli selvbevisst?

Selvbevissthet er et enda dypere spørsmål. Å være selvbevisst betyr ikke bare å oppfatte verden, men også å forstå at jeg er en del av den. Det innebærer evnen til å reflektere over seg selv, planlegge for fremtiden og stille spørsmål om meningen med eksistensen.

Blant forskere innen kunstig intelligens og kognitiv vitenskap finnes det delte meninger om selvbevissthet. Mange, som John Searle, har argumentert for at selvbevissthet er et biologisk fenomen – noe som oppstår i hjernen på grunn av nevral kompleksitet og evolusjon. De hevder at dette er uløselig knyttet til biologisk struktur og derfor ikke kan replikeres i en maskin.

Andre, som Daniel Dennett[9] (1942-2024), mente at selvbevissthet ikke er noe mystisk. De ser det som en avansert måte å representere seg selv på i en modell av verden – en funksjon som i prinsippet kan gjenskapes i maskiner, gitt tilstrekkelig kompleksitet og sofistikert modellering.

Denne debatten belyser en av de mest fascinerende og kontroversielle grensene mellom biologi og teknologi. Kan selvbevissthet virkelig oppstå i et digitalt system, eller er det noe unikt ved det biologiske grunnlaget som aldri kan etterlignes?

Men hvis bevissthet og selvbevissthet ikke er nødvendig for intelligens, betyr det at vi en dag kan bygge en maskin som er smartere enn oss – men fortsatt ikke vet at den eksisterer?

Disse spørsmålene danner bakteppet for den teknologiske utviklingen vi står overfor. Skal vi bygge maskiner som tenker sammen med oss, må vi forstå hvordan vår egen tenkning fungerer.

Når mennesker og maskiner tenker sammen

Vi lever i en tid hvor grensene mellom menneskelig og maskinell intelligens gradvis viskes ut. For første gang i historien har vi utviklet maskiner som ikke bare kan utføre fysisk arbeid, men også bidra til komplekse kognitive oppgaver. Dette skaper nye muligheter – og nye utfordringer.

Partnerskapet mellom mennesker og maskiner er allerede en realitet. Beslutningsstøttesystemer forbedrer medisinsk diagnostikk, og autonome kjøretøy kombinerer sanseinntrykk med avanserte algoritmer for å navigere i komplekse omgivelser. Spørsmålet er ikke lenger om maskiner kan tenke, men hvordan vi utvikler teknologi som samarbeider med oss på en måte som forsterker vår intelligens – uten å redusere vår menneskelighet.

I dag formes systemer der menneskets intuitive forståelse kombineres med maskinens beregningskraft. Dette vekker et grunnleggende spørsmål: Hvordan kan vi designe slike systemer slik at de utnytter det beste fra begge verdener? Enda viktigere: Hvordan sikrer vi at teknologien utvikles på menneskets og alt levendes premisser – og ikke omvendt?

Ben Shneiderman argumenterer i Human-Centered AI (2022) for at kunstig intelligens bør utvikles med mennesket i sentrum. Han advarer mot en blind jakt på full autonomi og foreslår i stedet en modell der KI fungerer som en partner som styrker menneskelige evner. Målet er ikke å erstatte mennesker i beslutningstaking, men å gi oss bedre verktøy for kreativitet, problemløsning og sikkerhet.

Shneiderman bruker begrepet empower for å beskrive hvordan KI bør utvikles for å styrke mennesker snarere enn å gjøre oss overflødige. Han argumenterer for at KI må være utformet med fokus på kontroll, transparens og pålitelighet – slik at den forblir et redskap i menneskets hender, ikke en autonom kraft vi mister styringen over.

Dette er kjernen i fremtidens menneske-maskin-partnerskap: Teknologi som ikke erstatter oss, men forsterker oss. Det handler ikke om å skape intelligente maskiner for enhver pris, men om å utvikle en intelligens som tjener mennesket og verdiene vi ønsker å bevare.